Опис регресійного аналізу. Основи лінійної регресії

ВИСНОВОК ПІДСУМКІВ

| Регресійна статистика | |

| Множинний R | 0,998364 |

| R-квадрат | 0,99673 |

| Нормований R-квадрат | 0,996321 |

| Стандартна помилка | 0,42405 |

| Спостереження | 10 |

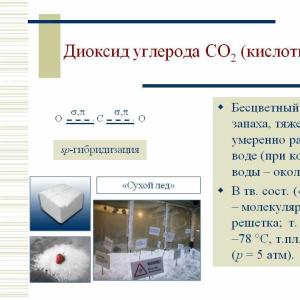

Спочатку розглянемо верхню частинурозрахунків, подану в таблиці 8.3а - регресійну статистику.

Величина R-квадрат, звана також мірою визначеності, характеризує якість отриманої регресійної прямої. Ця якість виражається ступенем відповідності між вихідними даними та регресійною моделлю (розрахунковими даними). Міра визначеності завжди знаходиться в межах інтервалу.

Найчастіше значення R-квадрат перебуває між цими значеннями, званими екстремальними, тобто. між нулем та одиницею.

Якщо значення R-квадрату близьке до одиниці, це означає, що побудована модель пояснює майже всю мінливість відповідних змінних. І навпаки, значення R-квадрату, близьке до нуля, означає погану якість побудованої моделі.

У нашому прикладі міра визначеності дорівнює 0,99673, що говорить про дуже хороше припасування регресійної прямої до вихідних даних.

Множинний R- Коефіцієнт множинної кореляції R - виражає ступінь залежності незалежних змінних (X) та залежної змінної (Y).

Множинний R дорівнює квадратного кореняз коефіцієнта детермінації, ця величина набуває значення в інтервалі від нуля до одиниці.

У простому лінійному регресійному аналізі множинний R дорівнює коефіцієнту кореляції Пірсона. Справді, множинний R у нашому випадку дорівнює коефіцієнту кореляції Пірсона з попереднього прикладу (0,998364).

| Коефіцієнти | Стандартна помилка | t-статистика | |

| Y-перетин | 2,694545455 | 0,33176878 | 8,121757129 |

| Змінна X 1 | 2,305454545 | 0,04668634 | 49,38177965 |

| * Наведено усічений варіант розрахунків | |||

Тепер розглянемо середню частинурозрахунків, подану в таблиці 8.3б. Тут дано коефіцієнт регресії b (2,305454545) і усунення осі ординат, тобто. константа a (2,694545455).

Виходячи з розрахунків, можемо записати рівняння регресії таким чином:

Y = x * 2,305454545 +2,694545455

Напрямок зв'язку між змінними визначається на підставі знаків (негативний або позитивний) коефіцієнтів регресії(Коефіцієнта b).

Якщо знак при коефіцієнт регресії- Позитивний, зв'язок залежної змінної з незалежною буде позитивним. У нашому випадку знак коефіцієнта регресії позитивний, отже, зв'язок також є позитивним.

Якщо знак при коефіцієнт регресії- негативний, зв'язок залежної змінної з незалежною є негативним (зворотним).

У таблиці 8.3в. представлені результати виведення залишків. Для того, щоб ці результати з'явилися у звіті, необхідно при запуску інструменту "Регресія" активувати чекбокс "Залишки".

ВИСНОВОК ЗАЛИШКУ

| Спостереження | Передбачене Y | Залишки | Стандартні залишки |

|---|---|---|---|

| 1 | 9,610909091 | -0,610909091 | -1,528044662 |

| 2 | 7,305454545 | -0,305454545 | -0,764022331 |

| 3 | 11,91636364 | 0,083636364 | 0,209196591 |

| 4 | 14,22181818 | 0,778181818 | 1,946437843 |

| 5 | 16,52727273 | 0,472727273 | 1,182415512 |

| 6 | 18,83272727 | 0,167272727 | 0,418393181 |

| 7 | 21,13818182 | -0,138181818 | -0,34562915 |

| 8 | 23,44363636 | -0,043636364 | -0,109146047 |

| 9 | 25,74909091 | -0,149090909 | -0,372915662 |

| 10 | 28,05454545 | -0,254545455 | -0,636685276 |

За допомогою цієї частини звіту ми можемо бачити відхилення кожної точки від збудованої лінії регресії. Найбільше абсолютне значення

Регресійний аналіз – це метод встановлення аналітичного вираження стохастичної залежності між досліджуваними ознаками. Рівняння регресії показує, як у середньому змінюється упри зміні будь-якого з x i , і має вигляд:

де у -залежна змінна (вона завжди одна);

х i - незалежні змінні (чинники) (їх може бути кілька).

Якщо незалежна змінна одна – це простий регресійний аналіз. Якщо ж їх кілька ( п  2),

то такий аналіз називається багатофакторним.

2),

то такий аналіз називається багатофакторним.

У ході регресійного аналізу вирішуються дві основні задачі:

побудова рівняння регресії, тобто. знаходження виду залежності між результатним показником та незалежними факторами x 1 , x 2 , …, x n .

оцінка важливості отриманого рівняння, тобто. визначення того, наскільки вибрані факторні ознаки пояснюють варіацію ознаки у.

Застосовується регресійний аналіз головним чином планування, і навіть розробки нормативної бази.

На відміну від кореляційного аналізу, що тільки відповідає питанням, чи існує зв'язок між аналізованими ознаками, регресійний аналіз дає і її формалізоване вираз. З іншого боку, якщо кореляційний аналіз вивчає будь-яку взаємозв'язок чинників, то регресійний - односторонню залежність, тобто. зв'язок, що показує, яким чином зміна факторних ознак впливає на результативний ознака.

Регресійний аналіз - один із найбільш розроблених методів математичної статистики. Строго кажучи, для реалізації регресійного аналізу потрібне виконання низки спеціальних вимог (зокрема, x l ,x 2 ,...,x n ;yмають бути незалежними, нормально розподіленими випадковими величинами з постійними дисперсіями). У реального життяСувора відповідність вимогам регресійного та кореляційного аналізу зустрічається дуже рідко, проте обидва ці методи дуже поширені в економічних дослідженнях. Залежності економіки можуть бути як прямими, а й зворотними і нелінійними. Регресійна модель може бути побудована за будь-якої залежності, проте в багатофакторному аналізі використовують тільки лінійні моделі виду:

![]()

Побудова рівняння регресії здійснюється, як правило, методом найменших квадратів, Суть якого полягає в мінімізації суми квадратів відхилень фактичних значень результатної ознаки від його розрахункових значень, тобто:

де т -кількість спостережень;

j

=a + b 1 x 1 j + b 2 x 2 j + ... + b n х n j

-

розрахункове значення результатного фактора

j

=a + b 1 x 1 j + b 2 x 2 j + ... + b n х n j

-

розрахункове значення результатного фактора

p align="justify"> Коефіцієнти регресії рекомендується визначати за допомогою аналітичних пакетів для персонального комп'ютера або спеціального фінансового калькулятора. У найпростішому випадку коефіцієнти регресії однофакторного лінійного рівняння регресії виду y = а + bхможна знайти за формулами:

Кластерний аналіз

Кластерний аналіз - одне із методів багатовимірного аналізу, призначений для угруповання (кластеризації) сукупності, елементи якої характеризуються багатьма ознаками. Значення кожної з ознак є координатами кожної одиниці досліджуваної сукупності в багатовимірному просторі ознак. Кожне спостереження, що характеризується значеннями кількох показників, можна як крапку у просторі цих показників, значення яких розглядаються як координати в багатовимірному просторі. Відстань між точками рі qз kкоординатами визначається як:

Основним критерієм кластеризації і те, що різницю між кластерами би мало бути більш істотні, ніж між спостереженнями, віднесеними одного кластеру, тобто. у багатовимірному просторі має дотримуватися нерівність:

![]()

де r 1, 2 - відстань між кластерами 1 та 2.

Як і процедури регресійного аналізу, процедура кластеризації досить трудомістка, її доцільно виконувати на комп'ютері.

У своїх роботах, датованих ще 1908 роком. Він описав його на прикладі роботи агента, який здійснює продаж нерухомості. У своїх записах спеціаліст з торгівлі будинками вів облік широкого спектра вихідних даних кожної конкретної будівлі. За результатами торгів визначалося, який фактор мав найбільший впливна ціну правочину.

Аналіз великої кількостіугод дав цікаві результати. На кінцеву вартість впливали безліч факторів, іноді призводячи до парадоксальних висновків і навіть до явних «викидів», коли будинок із високим початковим потенціалом продавався за заниженим ціновим показником.

Другим прикладом застосування такого аналізу наведено роботу, якій було довірено визначення винагороди співробітникам. Складність завдання полягала в тому, що була потрібна не роздача фіксованої суми кожному, а сувора відповідність її величини безпосередньо виконаній роботі. Поява безлічі завдань, мають практично подібний варіант рішення, зажадало більш детального вивчення на математичному рівні.

У значне місце було відведено під розділ «регресійний аналіз», у ньому об'єдналися практичні методи, що використовуються для дослідження залежностей, що підпадають під поняття регресійних. Ці взаємозв'язки спостерігаються між даними, отриманими під час статистичних досліджень.

Серед безлічі розв'язуваних задач основними ставить перед собою три цілі: визначення рівняння регресії загального вигляду; побудова оцінок параметрів, які є невідомими, що входять до складу рівняння регресії; перевірка статистичних регресійних гіпотез. В ході вивчення зв'язку, що виникає між парою величин, отриманих в результаті експериментальних спостережень і складових ряд (множина) типу (x1, y1), ..., (xn, yn), спираються на положення теорії регресії і припускають, що для однієї величини Y спостерігається певний ймовірнісний розподіл, при тому, що інше X залишається фіксованим.

Результат Y залежить від значення змінної X, ця залежність може визначатися різними закономірностями, при цьому на точність отриманих результатів впливає характер спостережень і мета аналізу. Експериментальна модель ґрунтується на певних припущеннях, які є спрощеними, але правдоподібними. Основною умовою є те, що параметр X є контрольованою величиною. Його значення задаються на початок експерименту.

Якщо в ході експерименту використовується пара неконтрольованих величин XY, то регресійний аналіз здійснюється тим самим способом, але для інтерпретації результатів, в ході якої вивчається зв'язок досліджуваних випадкових величин, застосовуються методи Методи математичної статистики не є абстрактною темою. Вони знаходять собі застосування в житті в самих різних сферахдіяльність людини.

У науковій літературідля визначення вище вказаного методу знайшов широке використаннятермін лінійний регресійний аналіз. Для змінної X застосовують термін регресор або предиктор, а залежні Y змінні ще називають критеріальними. У цій термінології відбивається лише математична залежність змінних, але не слідчо-причинні відносини.

Регресійний аналізслужить найбільш поширеним методом, який використовується в ході обробки результатів різних спостережень. Фізичні та біологічні залежності вивчаються за допомогою даного методу, він реалізований і в економіці, і в техніці. Маса інших областей використовують моделі регресійного аналізу. Дисперсійний аналіз, статистичний аналізбагатовимірний тісно співпрацюють з цим способом вивчення.

Метою регресійного аналізу є вимірювання зв'язку між залежною змінною та однією (парний регресійний аналіз) або декількома (множинним) незалежними змінними. Незалежні змінні називають також факторними, що пояснюють, визначальними, регресорами та предикторами.

Залежну змінну іноді називають обумовленою, пояснюваною, «відгуком». Надзвичайно широке поширенняРегресійний аналіз в емпіричних дослідженнях пов'язаний не тільки з тим, що це зручний інструмент тестування гіпотез. Регресія, особливо множинна, є ефективним методоммоделювання та прогнозування.

Пояснення принципів роботи з регресійним аналізом почнемо з простішого - парного методу.

Парний регресійний аналіз

Перші дії при використанні регресійного аналізу будуть практично ідентичними нами в рамках обчислення коефіцієнта кореляції. Три основні умови ефективності кореляційного аналізу за методом Пірсона – нормальний розподіл змінних, інтервальний вимір змінних, лінійний зв'язок між змінними – актуальні і для множинної регресії. Відповідно, на першому етапі будуються діаграми розсіювання, проводиться статистично-описовий аналіз змінних та обчислюється лінія регресії. Як і рамках кореляційного аналізу, лінії регресії будуються шляхом найменших квадратів.

Щоб наочно проілюструвати різницю між двома методами аналізу даних, звернемося до вже розглянутому прикладу зі змінними «підтримка УПС» і «частка сільського населення». Вихідні дані ідентичні. Відмінність у діаграмах розсіювання полягатиме у цьому, що у регресійному аналізі коректно відкладати залежну змінну - у разі «підтримка УПС» по осі Y, тоді як і кореляційному аналізі це має значення. Після чищення викидів діаграма розсіювання має вигляд:

Принципова ідея регресійного аналізу у тому, що, маючи загальну тенденціюдля змінних - як лінії регресії, - можна передбачити значення залежної змінної, маючи значення незалежної.

Уявимо звичайну математичну лінійну функцію. Будь-яку пряму в евклідовому просторі можна описати формулою:

де а - константа, що задає зміщення осі ординат; b – коефіцієнт, що визначає кут нахилу лінії.

Знаючи кутовий коефіцієнт і константу, можна розрахувати (передбачити) значення для будь-якого х.

Ця найпростіша функція і лягла в основу моделі регресійного аналізу з тим застереженням, що значення ми передбачимо не точно, а в рамках певного довірчого інтервалу, тобто. приблизно.

Константою є точка перетину лінії регресії та осі ординат (F-перетин, у статистичних пакетах, як правило, що позначається «interceptor»). У нашому прикладі із голосуванням за УПС її округлене значення становитиме 10,55. Кутовий коефіцієнт Ъ дорівнюватиме приблизно -0,1 (як і в кореляційному аналізі, знак показує тип зв'язку - пряма або зворотна). Таким чином, отримана модель матиме вигляд СП = -0,1 х Сел. нас. + 10,55.

УПС = -0,10 х 47 + 10,55 = 5,63.

Різниця між вихідним і передбаченим значеннями називається залишком (з цим терміном – важливим для статистики – ми вже стикалися при аналізі таблиць сполученості). Так, для випадку «Республіка Адигея» залишок дорівнюватиме 3,92 - 5,63 = -1,71. Чим більше модульне значення залишку, тим менш успішно передбачено значення.

Розраховуємо передбачені значення та залишки для всіх випадків:

|

Аналіз співвідношення вихідних та передбачених значень служить для оцінки якості отриманої моделі, її прогностичної здатності. Одним із головних показників регресійної статистики є множинний коефіцієнткореляції R - коефіцієнт кореляції між вихідними та передбаченими значеннями залежної змінної. У парному регресійному аналізі він дорівнює звичайному коефіцієнту кореляції Пірсона між залежною та незалежною змінною, у нашому випадку – 0,63. Щоб змістовно інтерпретувати множинний R, його необхідно перетворити на коефіцієнт детермінації. Це робиться так само, як і в кореляційному аналізі – зведенням у квадрат. Коефіцієнт детермінації R-квадрат (R 2) показує частку варіації залежної змінної, яка пояснюється незалежною (незалежними) змінними.

У разі R 2 = 0,39 (0,63 2); це означає, що змінна «частка сільського населення» пояснює приблизно 40% варіації змінної «підтримка УПС». Чим більша величина коефіцієнта детермінації, тим вища якість моделі.

Іншим показником якості моделі є стандартна помилка оцінки (standard error of estimate). Це показник того, наскільки сильно точки розкидані навколо лінії регресії. Мірою розкиду для інтервальних змінних є стандартне відхилення. Відповідно, стандартна помилкаоцінки – це стандартне відхилення розподілу залишків. Чим вище її значення, тим сильніший розкид і тим гірша модель. У разі стандартна помилка становить 2,18. Саме на цю величину наша модель "помилятиметься в середньому" при прогнозуванні значення змінної "підтримка УПС".

Регресійна статистика включає також дисперсійний аналіз. За його допомогою ми з'ясовуємо: 1) яка частка варіації (дисперсії) залежної змінної пояснюється незалежною змінною; 2) яка частка дисперсії залежної змінної посідає залишки (непояснена частина); 3) яке відношення цих двох величин (/"-відношення).Дисперсійна статистика особливо важлива для вибіркових досліджень - вона показує, наскільки ймовірно наявність зв'язку між незалежною і залежною змінними в генеральної сукупності. Однак і для суцільних досліджень (як у нашому прикладі) вивчення результатів дисперсійного аналізунедаремно. І тут перевіряють, чи викликана виявлена статистична закономірність збігом випадкових обставин, наскільки вона у тому комплексу умов, у яких перебуває обстежувана сукупність, тобто. встановлюється не істинність отриманого результату для більш широкої генеральної сукупності, а ступінь його закономірності, свободи від випадкових впливів.

У нашому випадку статистика дисперсійного аналізу така:

| SS | df | MS | F | значення | |

| Регрес. | 258,77 | 1,00 | 258,77 | 54,29 | 0.000000001 |

| Залиш. | 395,59 | 83,00 | Л,11 | ||

| Усього | 654,36 |

F-відношення 54,29 значимо лише на рівні 0,0000000001. Відповідно, ми можемо з упевненістю відкинути нульову гіпотезу (що виявлений нами зв'язок носить випадковий характер).

Аналогічну функцію виконує критерій t, але вже щодо регресійних коефіцієнтів(кутового та F-перетину). За допомогою критерію/перевіряємо гіпотезу про те, що в генеральній сукупності регресійні коефіцієнти дорівнюють нулю. У нашому випадку ми знову можемо впевнено відкинути нульову гіпотезу.

Множинний регресійний аналіз

Модель множинної регресії практично ідентична моделі парної регресії; різниця лише тому, що у лінійну функцію послідовно включаються кілька незалежних змінних:

Y = b1X1 + b2X2 + … + bpXp + а.

Якщо незалежних змінних більше двох, ми не маємо можливості отримати візуальне поданняпро їхній зв'язок, у цьому плані множинна регресія менш «наочна», ніж парна. За наявності двох незалежних змінних дані корисно відобразити на тривимірній діаграмі розсіювання. У професійних статистичних пакетах програм (наприклад Statisticа) існує опція обертання тривимірної діаграми, що дозволяє добре візуально подати структуру даних.

При роботі з множинною регресією, На відміну від парної, необхідно визначати алгоритм аналізу. Стандартний алгоритм включає у підсумкову регресійну модель усі наявні предиктори. Покроковий алгоритмпередбачає послідовне включення (виключення) незалежних змінних, виходячи з їх пояснювальної «ваги». Покроковий методхороший, коли є багато незалежних змінних; він «очищає» модель від відверто слабких предикторів, роблячи її компактнішою і лаконічнішою.

Додатковою умовою коректності множинної регресії (поряд з інтервальністю, нормальністю та лінійністю) є відсутність мультиколлінеарності – наявності сильних кореляційних зв'язків між незалежними змінними.

Інтерпретація статистики множинної регресії включає всі злементи, розглянуті нами для випадку парної регресії. Крім того, у статистиці множинного регресійного аналізу є й інші важливі складові.

Роботу з множинною регресією ми проілюструємо на прикладі тестування гіпотез, що пояснюють відмінності в рівні електоральної активності в регіонах Росії. У ході конкретних емпіричних досліджень було висловлено припущення, що на рівень явки виборців впливають:

Національний чинник (змінна «російське населення»; операціоналізована як частка російського населення суб'єктах РФ). Передбачається, що частка російського населення веде до зниження активності виборців;

Фактор урбанізації (змінна «міське населення»; операціоналізована як частка міського населення в суб'єктах РФ, з цим фактором ми вже працювали в рамках кореляційного аналізу). Передбачається, що збільшення частки міського населення також призводить до зниження активності виборців.

Залежна змінна - «інтенсивність виборчої активності» («актив») операціоналізована через усереднені дані явки по регіонах на федеральних виборах з 1995 по 2003 р. Вихідна таблиця даних для двох незалежних та однієї залежної змінної матиме такий вигляд:

| Випадок | Змінні | ||

| актив. | Гір. нас. | Рос. нас. | |

| Республіка Адигея | 64,92 | 53 | 68 |

| Республіка Алтай | 68,60 | 24 | 60 |

| Республіка Бурятія | 60,75 | 59 | 70 |

| Республіка Дагестан | 79,92 | 41 | 9 |

| Республіка Інгушетія | 75,05 | 41 | 23 |

| Республіка Калмикія | 68,52 | 39 | 37 |

| Карачаєво-Черкеська Республіка | 66,68 | 44 | 42 |

| Республіка Карелія | 61,70 | 73 | 73 |

| Республіка Комі | 59,60 | 74 | 57 |

| Республіка Марій Ел | 65,19 | 62 | 47 |

І т.д. (після чищення викидів залишається 83 випадки із 88)

Статистика, що описує якість моделі:

1. Множинний R = 0,62; Л-квадрат = 0,38. Отже, національний фактор та фактор урбанізації разом пояснюють близько 38% варіації змінної «електоральної активності».

2. Середня помилкаскладає 3,38. Саме настільки «в середньому помиляється» побудована модель під час прогнозування рівня явки.

3. /л-відношення поясненої та непоясненої варіації становить 25,2 на рівні 0,000000003. Нульова гіпотеза про випадковість виявлених зв'язків відкидається.

4. Критерій /для константи та регресійних коефіцієнтів змінних «міське населення» і «російське населення» значимо на рівні 0,0000001; 0,00005 та 0,007 відповідно. Нульова гіпотеза про випадковість коефіцієнтів відкидається.

Додаткова корисна статистика в аналізі співвідношення вихідних та передбачуваних значень залежної змінної – відстань Махаланобіса та відстань Кука. Перше - міра унікальності випадку (показує, наскільки поєднання значень всіх незалежних змінних для даного випадкувідхиляється від середнього значення за всіма незалежними змінними одночасно). Друге – міра впливовості випадку. p align="justify"> Різні спостереження по-різному впливають на нахил лінії регресії, і за допомогою відстані Кука можна зіставляти їх за цим показником. Це буває корисно при чищенні викидів (викид можна уявити як надмірно впливовий випадок).

У нашому прикладі до унікальних та впливових випадків, зокрема, відноситься Дагестан.

| Випадок | Вихідні значення | Предська значення | Залишки | Відстань Махаланобіса | Відстань |

| Адигея | 64,92 | 66,33 | -1,40 | 0,69 | 0,00 |

| Республіка Алтай | 68,60 | 69.91 | -1,31 | 6,80 | 0,01 |

| Республіка Бурятія | 60,75 | 65,56 | -4,81 | 0,23 | 0,01 |

| Республіка Дагестан | 79,92 | 71,01 | 8,91 | 10,57 | 0,44 |

| Республіка Інгушетія | 75,05 | 70,21 | 4,84 | 6,73 | 0,08 |

| Республіка Калмикія | 68,52 | 69,59 | -1,07 | 4,20 | 0,00 |

Власне регресійна модель має наступні параметри: У-перетин (константа) = 75,99; Ь (Мір. нас.) = -0,1; Ъ (Рус. нас.) = -0,06. Підсумкова формула.

Регресійний аналіз досліджує залежність певної величини від іншої або декількох інших величин. Регресійний аналіз застосовується переважно у середньостроковому прогнозуванні, а також у довгостроковому прогнозуванні. Середньо- та довгостроковий періоди дають можливість встановлення змін у середовищі бізнесу та обліку впливів цих змін на досліджуваний показник.

Для здійснення регресійного аналізу необхідно:

наявність щорічних даних за досліджуваними показниками,

наявність одноразових прогнозів, тобто. таких прогнозів, які не одужують з надходженням нових даних.

Регресійний аналіз зазвичай проводиться для об'єктів, що мають складну, багатофакторну природу, таких як обсяг інвестицій, прибуток, обсяги продажів та ін.

При нормативному методі прогнозуваннявизначаються шляхи та терміни досягнення можливих станів явища, що приймаються як ціль. Йдеться про прогнозування досягнення бажаних станів явища на основі заздалегідь заданих норм, ідеалів, стимулів та цілей. Такий прогноз відповідає питанням: якими шляхами можна досягти бажаного? Нормативний метод найчастіше застосовується для програмних чи цільових прогнозів. Використовуються як кількісний вираз нормативу, і певна шкала можливостей оціночної функції.

У разі використання кількісного виразу, наприклад фізіологічних та раціональних норм споживання окремих продовольчих та непродовольчих товарів, розроблених фахівцями для різних груп населення, можна визначити рівень споживання цих товарів на роки, що передують досягненню зазначеної норми. Такі розрахунки називають інтерполяцією. Інтерполяція - це спосіб обчислення показників, які бракують динамічному ряду явища, на основі встановленого взаємозв'язку. Приймаючи фактичне значення показника і його нормативів за крайні члени динамічного ряду, можна визначити величини значень всередині цього ряду. Тому інтерполяцію вважають за нормативний метод. Раніше наведена формула (4), яка використовується в екстраполяції, може застосовуватися в інтерполяції, де у п буде характеризувати вже не фактичні дані, а норматив показника.

У разі використання в нормативному методі шкали (поля, спектра) можливостей оціночної функції, тобто функції розподілу переваги, вказують приблизно таку градацію: небажано - менш бажано - більш бажано - найбільш бажано - оптимально (норматив).

Нормативний метод прогнозування допомагає виробити рекомендації щодо підвищення рівня об'єктивності, отже, ефективності рішень.

Моделювання, мабуть, найскладніший метод прогнозування Математичне моделювання означає опис економічного явища за допомогою математичних формул, рівнянь та нерівностей. Математичний апарат повинен досить точно відображати прогнозне тло, хоча повністю відобразити всю глибину і складність прогнозованого об'єкта досить важко. Термін "модель" утворений від латинського слова modelus, що означає "захід". Тому моделювання правильніше було вважати не методом прогнозування, а методом вивчення аналогічного явища на моделі.

У широкому значенні моделями називаються заступники об'єкта дослідження, що знаходяться з ним у такій схожості, що дозволяє отримати нове знання про об'єкт. Модель слід розглядати як математичний опис об'єкта. У цьому випадку модель визначається як явище (предмет, установка), яке знаходиться в певній відповідності до об'єкта, що вивчається, і може його замінювати в процесі дослідження, представляючи інформацію про об'єкт.

При більш вузькому розумінні моделі вона розглядається як об'єкт прогнозування, її дослідження дозволяє отримати інформацію про можливі стани об'єкта в майбутньому та шляхи досягнення цих станів. У цьому випадку метою прогнозної моделі є отримання інформації не про об'єкт взагалі, а лише про його майбутні стани. Тоді при побудові моделі буває неможливо провести пряму перевірку її відповідності об'єкту, так як модель є лише його майбутнім станом, а сам об'єкт в даний час може бути відсутнім або мати інше існування.

Моделі можуть бути матеріальними та ідеальними.

В економіці використовуються ідеальні моделі. Найбільш досконалою ідеальною моделлю кількісного опису соціально-економічного (економічного) явища є математична модель, яка використовує числа, формули, рівняння, алгоритми чи графічне уявлення. За допомогою економічних моделей визначають:

залежність між різними економічними показниками;

різного роду обмеження, що накладаються на показники;

критерії, що дозволяють оптимізувати процес.

Змістовне опис об'єктаможе бути представлено у вигляді його формалізованої схеми, яка вказує, які параметри та вихідну інформацію потрібно зібрати, щоб обчислити шукані величини. p align="justify"> Математична модель на відміну від формалізованої схеми містить конкретні числові дані, що характеризують об'єкт Розробка математичної моделі багато в чому залежить від уявлення прогнозиста про сутність модельованого процесу. На основі своїх уявлень він висуває робочу гіпотезу, за допомогою якої створюється аналітичний запис моделі у вигляді формул, рівнянь та нерівностей. Через війну розв'язання системи рівнянь отримують конкретні параметри функції, якими описується зміна змінних величин у часі.

Порядок і послідовність роботи як елемент організації прогнозування визначається залежно від методу прогнозування, що застосовується. Зазвичай ця робота виконується у кілька етапів.

1-й етап - прогнозна ретроспекція, т. е. встановлення об'єкта прогнозування та прогнозного тла. Робота на першому етапі виконується в такій послідовності:

формування опису об'єкта в минулому, що включає передпрогнозний аналіз об'єкта, оцінку його параметрів, їх значущості та взаємних зв'язків,

визначення та оцінка джерел інформації, порядку та організації роботи з ними, збирання та розміщення ретроспективної інформації;

постановка завдань дослідження.

Виконуючи завдання прогнозної ретроспекції, прогнозисти досліджують історію розвитку об'єкта та прогнозного фону з метою отримання їх систематизованого опису.

2-й етап - прогнозний діагноз, у ході якого досліджується систематизований опис об'єкта прогнозування та прогнозного фону з метою виявлення тенденцій їх розвитку та вибору моделей та методів прогнозування. Робота виконується у такій послідовності:

розробка моделі об'єкта прогнозу, у тому числі формалізований опис об'єкта; перевірка ступеня адекватності моделі об'єкту;

вибір методів прогнозування (основного та допоміжних), розробка алгоритму та робочих програм.

3-й етап - протекція, т. е. процес широкої розробки прогнозу, зокрема: 1) розрахунок прогнозованих параметрів заданий період попередження; 2) синтез окремих складових прогнозу.

4-й етап - оцінка прогнозу, зокрема його верифікація, т. е. визначення ступеня достовірності, точності та обгрунтованості.

У ході проспектії та оцінки на підставі попередніх етапів вирішуються завдання прогнозу та його оцінка.

Зазначена етапність є зразковою і залежить від основного методу прогнозування.

Результати прогнозу оформляються у вигляді довідки, доповіді чи іншого матеріалу та надаються замовнику.

У прогнозуванні може бути зазначена величина відхилення прогнозу від дійсного стану об'єкта, яка називається помилкою прогнозу, яка розраховується за формулою:

;

;

; .

(9.3)

.

(9.3)

Джерела помилок у прогнозуванні

Основними джерелами можуть бути:

1. Просте перенесення (екстраполяція) даних із минулого на майбутнє (наприклад, відсутність у фірми інших варіантів прогнозу, крім 10% зростання продажів).

2. Неможливість точно визначити ймовірність події та її впливу на досліджуваний об'єкт.

3. Непередбачені труднощі (руйнівні події), які впливають здійснення плану, наприклад, раптове звільнення начальника відділу збуту.

Загалом точність прогнозування підвищується у міру накопичення досвіду прогнозування та відпрацювання його методів.